Le terme « big data » désigne littéralement une énorme quantité d’informations stockées sur n’importe quel support.

- Sources de mégadonnées

- L'histoire de l'émergence et du développement du Big Data

- Techniques et méthodes d'analyse et de traitement du Big Data

- Perspectives et tendances du développement du Big Data

- Mégadonnées dans le marketing et les affaires

- Exemples d'utilisation du Big Data

- Problèmes de mégadonnées

- Marché des technologies du Big Data en Russie et dans le monde

- Les meilleurs livres sur le Big Data

De plus, ce volume est si important qu’il est peu pratique de le traiter avec les logiciels ou matériels habituels, et dans certains cas, c’est totalement impossible.

Le Big Data n’est pas seulement les données elles-mêmes, mais aussi les technologies pour les traiter et les utiliser, les méthodes pour trouver les informations nécessaires dans de grands tableaux. Le problème des mégadonnées est toujours ouvert et vital pour tous les systèmes qui accumulent une grande variété d’informations depuis des décennies.

Sources de mégadonnées

Les réseaux sociaux sont un exemple de source typique de mégadonnées – chaque profil ou page publique est une petite goutte dans un océan d’informations non structuré. De plus, quelle que soit la quantité d’informations stockées dans un profil particulier, l’interaction avec chacun des utilisateurs doit être aussi rapide que possible.

Les mégadonnées s’accumulent constamment dans presque tous les domaines de la vie humaine. Cela inclut toute industrie liée aux interactions humaines ou à l’informatique. Il s’agit des médias sociaux, de la médecine et du secteur bancaire, ainsi que des systèmes d’appareils qui reçoivent de nombreux résultats de calculs quotidiens. Par exemple, les observations astronomiques, les informations météorologiques et les informations provenant des dispositifs de sondage terrestre.

Les informations provenant de divers systèmes de suivi en temps réel sont également envoyées aux serveurs d’une entreprise particulière. Télévision et radio, bases d’appels des opérateurs mobiles – l’interaction de chaque personne avec eux est minime, mais dans l’ensemble, toutes ces informations deviennent des mégadonnées.

Les technologies de mégadonnées font désormais partie intégrante de la R&D et du commerce. De plus, ils commencent à s’emparer de la sphère de l’administration publique – et partout l’introduction de systèmes de plus en plus efficaces pour stocker et manipuler l’information est nécessaire.

L’histoire de l’émergence et du développement du Big Data

Le terme « big data » est apparu pour la première fois dans la presse en 2008, lorsque le rédacteur en chef de Nature Clifford Lynch a publié un article sur la manière de faire progresser l’avenir de la science à l’aide des technologies du big data. Jusqu’en 2009, ce terme n’était considéré que du point de vue de l’analyse scientifique, mais après la publication de plusieurs autres articles, la presse a commencé à utiliser largement le concept de Big Data – et continue de l’utiliser à l’heure actuelle.

En 2010, les premières tentatives pour résoudre le problème croissant des mégadonnées ont commencé à apparaître. Des produits logiciels ont été lancés, dont l’action visait à minimiser les risques lors de l’utilisation d’énormes tableaux d’informations.

En 2011, de grandes entreprises telles que Microsoft, Oracle, EMC et IBM se sont intéressées au Big Data – elles ont été les premières à utiliser le Big Data dans leurs stratégies de développement, et avec beaucoup de succès.

Les universités ont commencé à étudier les mégadonnées en tant que matière distincte dès 2013 – maintenant, non seulement les sciences des données, mais aussi l’ingénierie, ainsi que les matières informatiques, sont confrontées à des problèmes dans ce domaine.

Techniques et méthodes d’analyse et de traitement du Big Data

Les principales méthodes d’analyse et de traitement des données sont les suivantes :

Méthodes de classe ou exploration de données

Ces méthodes sont assez nombreuses, mais elles sont unies par une chose : les outils mathématiques utilisés en conjonction avec les réalisations dans le domaine des technologies de l’information.

Crowdsourcing

Cette technique permet d’obtenir simultanément des données de plusieurs sources, et le nombre de ces dernières est pratiquement illimité.

Test A/B

A partir de la quantité totale de données, un ensemble de contrôle d’éléments est sélectionné, qui est à son tour comparé à d’autres ensembles similaires, où l’un des éléments a été modifié. La réalisation de tels tests permet de déterminer quelles fluctuations de paramètres ont le plus d’effet sur la population témoin. Grâce aux volumes de Big Data, il est possible d’effectuer un très grand nombre d’itérations, chacune s’approchant du résultat le plus fiable.

Analyse prédictive

Les spécialistes dans ce domaine tentent de prédire et de planifier à l’avance le comportement de l’objet contrôlé afin de prendre la décision la plus avantageuse dans cette situation.

Apprentissage automatique (intelligence artificielle)

Il est basé sur une analyse empirique de l’information et la construction subséquente d’algorithmes d’auto-apprentissage pour les systèmes.

Analyse du réseau

La méthode la plus courante pour l’étude des réseaux sociaux – après avoir reçu des données statistiques, les nœuds créés dans la grille sont analysés, c’est-à-dire les interactions entre les utilisateurs individuels et leurs communautés.

Perspectives et tendances du développement du Big Data

En 2017, alors que le big data n’est plus quelque chose de nouveau et d’inconnu, son importance n’a non seulement pas diminué, mais a même augmenté. Désormais, les experts parient que l’analyse de grandes quantités de données deviendra disponible non seulement pour les organisations géantes, mais également pour les petites et moyennes entreprises. Cette approche est prévue pour être mise en œuvre à l’aide des composants suivants :

Stockage dans le cloud

Le stockage et le traitement des données deviennent plus rapides et plus économiques – par rapport aux coûts de maintenance de votre propre centre de données et à l’éventuelle augmentation du personnel, la location d’un cloud semble être une alternative beaucoup moins chère.

Utiliser des données sombres

Les soi-disant « données sombres » sont toutes les informations non numérisées sur une entreprise qui ne jouent pas un rôle clé dans son utilisation directe, mais peuvent servir de raison pour passer à un nouveau format de stockage des informations.

Intelligence artificielle et apprentissage en profondeur

La technologie d’apprentissage de l’intelligence artificielle, qui imite la structure et le fonctionnement du cerveau humain, est la mieux adaptée pour traiter une grande quantité d’informations en constante évolution. Dans ce cas, la machine fera tout ce qu’une personne aurait à faire, mais la probabilité d’erreur est considérablement réduite.

Blockchain

Cette technologie permet d’accélérer et de simplifier de nombreuses transactions Internet, y compris internationales. Un autre avantage de Blockchain est qu’il réduit les coûts de transaction.

Libre-service et réductions de prix

En 2017, il est prévu d’introduire des « plateformes en libre-service » – ce sont des plates-formes gratuites où les représentants des petites et moyennes entreprises pourront évaluer de manière indépendante les données qu’ils stockent et les systématiser.

Mégadonnées dans le marketing et les affaires

Toutes les stratégies marketing reposent en quelque sorte sur la manipulation de l’information et l’analyse des données existantes. C’est pourquoi l’utilisation des mégadonnées peut prédire et permettre d’ajuster le développement futur de l’entreprise.

Par exemple, une enchère RTB créée sur la base de données volumineuses vous permet d’utiliser la publicité plus efficacement – un certain produit ne sera présenté qu’au groupe d’utilisateurs intéressés à l’acheter.

Quel est l’avantage d’utiliser les technologies du Big Data dans le marketing et les affaires ?

- Avec leur aide, vous pouvez créer de nouveaux projets beaucoup plus rapidement, qui sont susceptibles de devenir populaires auprès des acheteurs.

- Ils aident à relier les exigences des clients à un service existant ou prévu et ainsi à les ajuster.

- Les méthodes de Big Data vous permettent d’évaluer le degré de satisfaction actuel de tous les utilisateurs et de chacun individuellement.

- L’augmentation de la fidélité des clients est obtenue grâce aux méthodes de traitement du Big Data.

- Attirer le public cible sur Internet devient plus facile grâce à la capacité de contrôler d’énormes quantités de données.

Par exemple, l’un des services les plus populaires pour prédire la popularité probable d’un produit particulier est Google.trends. Il est largement utilisé par les spécialistes du marketing et les analystes, leur permettant d’obtenir des statistiques sur l’utilisation d’un produit donné dans le passé et des prévisions pour la prochaine saison. Cela permet aux chefs d’entreprise de répartir plus efficacement le budget publicitaire, de déterminer dans quel domaine il est préférable d’investir de l’argent.

Exemples d’utilisation du Big Data

L’introduction active des technologies Big Data sur le marché et dans la vie moderne a commencé juste après qu’elles aient commencé à être utilisées par des entreprises de renommée mondiale qui ont des clients dans presque tous les coins du globe.

Ce sont des géants sociaux tels que Facebook et Google, IBM., ainsi que des structures financières comme Master Card, VISA et Bank of America.

Par exemple, IBM applique des techniques de mégadonnées aux transactions en espèces. Avec leur aide, 15 % de transactions frauduleuses supplémentaires ont été détectées, ce qui a augmenté le montant des fonds protégés de 60 %. Les problèmes de faux positifs du système ont également été résolus – leur nombre a été réduit de plus de moitié.

VISA a également utilisé le Big Data, traquant les tentatives frauduleuses d’effectuer une transaction particulière. Grâce à cela, ils économisent chaque année plus de 2 milliards de dollars américains sur les fuites.

Le ministère allemand du Travail a réussi à réduire les coûts de 10 milliards d’euros en mettant en œuvre un système de mégadonnées dans le travail d’octroi des allocations de chômage. Dans le même temps, il a été révélé qu’un cinquième des citoyens perçoivent ces prestations sans justification.

Le Big Data n’a pas non plus contourné l’industrie du jeu. Ainsi, les développeurs de World of Tanks ont mené une étude des informations sur tous les joueurs et comparé les indicateurs disponibles de leur activité. Cela a permis de prédire l’éventuelle rotation future des joueurs – sur la base des hypothèses formulées, les représentants de l’organisation ont pu interagir plus efficacement avec les utilisateurs.

Les organisations notables utilisant le Big Data incluent également HSBC, Nasdaq, Coca-Cola, Starbucks et AT&T.

Problèmes de mégadonnées

Le plus gros problème avec les mégadonnées est le coût de leur traitement. Cela peut inclure à la fois un équipement coûteux et le coût des salaires de spécialistes qualifiés capables de traiter d’énormes quantités d’informations. Évidemment, l’équipement devra être régulièrement mis à jour afin qu’il ne perde pas ses performances minimales à mesure que la quantité de données augmente.

Le deuxième problème est à nouveau lié à la grande quantité d’informations à traiter. Si, par exemple, une étude donne non pas 2-3, mais un grand nombre de résultats, il est très difficile de rester objectif et de ne sélectionner dans le flux général de données que ceux qui auront un réel impact sur l’état d’un phénomène.

Problème de confidentialité des mégadonnées. La plupart des services de service client passant à l’utilisation des données en ligne, il est très facile de devenir la prochaine cible des cybercriminels. Même le simple fait de stocker des informations personnelles sans effectuer de transactions en ligne peut avoir des conséquences indésirables pour les clients du stockage en nuage.

Le problème de la perte d’informations. Les précautions exigent de ne pas se limiter à une simple sauvegarde ponctuelle des données, mais de faire au moins 2-3 copies de sauvegarde du stockage. Cependant, à mesure que le volume augmente, la complexité de la redondance augmente – et les spécialistes informatiques tentent de trouver la meilleure solution à ce problème.

Marché des technologies du Big Data en Russie et dans le monde

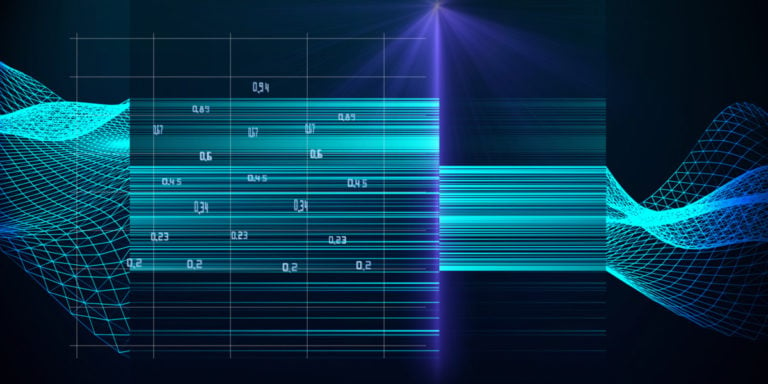

En 2014, 40 % du marché du big data est constitué de services. Légèrement inférieurs (38%) à cet indicateur sont les revenus de l’utilisation du Big Data dans les équipements informatiques. Les 22 % restants sont dans les logiciels.

Selon les statistiques, les produits les plus utiles du segment mondial pour résoudre les problèmes de Big Data sont les plateformes d’analyse In-memory et NoSQL. 15 et 12 % du marché, respectivement, sont occupés par les logiciels d’analyse de fichiers journaux et les plates-formes Columnar. Mais Hadoop / MapReduce en pratique faire face aux problèmes de big data n’est pas très efficace.

Résultats de la mise en œuvre des technologies de mégadonnées :

- la croissance de la qualité du service client ;

- optimiser l’intégration de la chaîne d’approvisionnement ;

- optimisation de la planification de l’organisation ;

- accélération de l’interaction avec les clients ;

- améliorer l’efficacité du traitement des demandes des clients ;

- réduire les coûts de service ;

- optimiser le traitement des demandes des clients.

Les meilleurs livres sur le Big Data

« Le visage humain du Big Data » par Rick Smolan et Jennifer Erwitt

Adapté à l’étude initiale des technologies de traitement de données volumineuses – il vous met facilement et clairement à jour. Il montre clairement comment l’abondance d’informations a affecté la vie quotidienne et tous ses domaines : science, affaires, médecine, etc. Contient de nombreuses illustrations, de sorte qu’il est perçu sans trop d’effort.

Introduction à l’exploration de données par Pang-Ning Tan, Michael Steinbach et Vipin Kumar

Également un livre utile pour les débutants sur le Big Data, qui explique comment travailler avec le Big Data de manière « du simple au complexe ». Il couvre de nombreux points importants au stade initial: préparation au traitement, visualisation, OLAP, ainsi que certaines méthodes d’analyse et de classification des données.

Apprentissage automatique Python par Sebastian Raska

Un guide pratique pour utiliser et travailler avec le Big Data à l’aide du langage de programmation Python. Convient aussi bien aux élèves-ingénieurs qu’aux professionnels qui souhaitent approfondir leurs connaissances.

« Hadoop pour les nuls », Dirk Derus, Paul S. Zikopoulos, Roman B. Melnik

Hadoop est un projet conçu spécifiquement pour fonctionner avec des programmes distribués qui organisent l’exécution d’actions sur des milliers de nœuds en même temps. Sa connaissance aidera à comprendre plus en détail l’application pratique des mégadonnées.